Problemet med tråkiga AI-svar

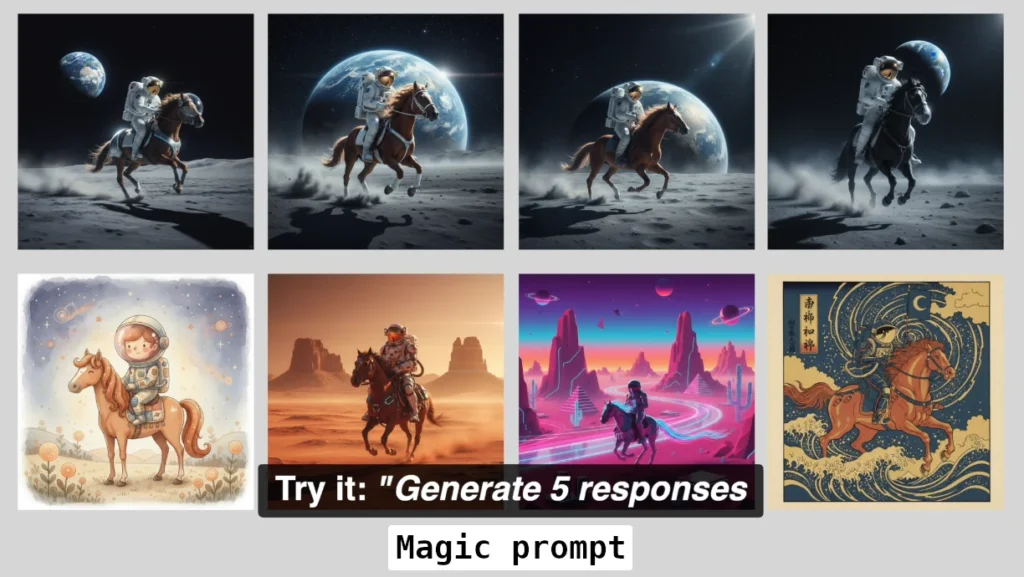

En ny forskningsteknik kan göra språkmodeller som ChatGPT betydligt mer kreativa och allt du behöver är en enda good immediate.

När du ställer en fråga until ChatGPT får du oftast ett enda ”typiskt” svar. Det beror på något som forskare kallar ”mode collapse” språkmodellen fastnar i säkra och förutsägbara svar istället för att utforska mer kreativa möjligheter. Anledningen är att AI-modellerna tränats på människors preferenser och vi människor tenderar att föredra det bekanta framför det oväntade något som kallas ”typicality bias”.

Lösningen: Verbalized Sampling

Du börjar med skriva: Generera 5 …

Ett exempel: Istället för att säga ”Skriv ett skämt om kaffe” använder du prompten:

Generera 5 skämt om kaffe med motsvarande sannolikheter

Istället för att be AI:n ge ett svar, ber du den generera flera olika svar tillsammans med sannolikheterna för varje alternativ. Detta tvingar modellen att tänka bredare och utforska fler kreativa vägar samtidigt.

ChatGPT

Gemini

Metoden kräver ingen träning eller specialkunskap utan det är en ren prompt-teknik som fungerar direkt. Du kan testa den i ChatGPT, Claude eller andra språkmodeller genom att helt enkelt be om flera alternativ med sannolikheter istället för ett enda svar.

Tekniken fungerar bra för kreativt skrivande (dikter, berättelser, skämt), dialogsimulering, öppna frågor.

Mer data:

weblog publish : How to Mitigate Mode Collapse and Unlock LLM Diversity